La fine della privacy della corrispondenza digitale

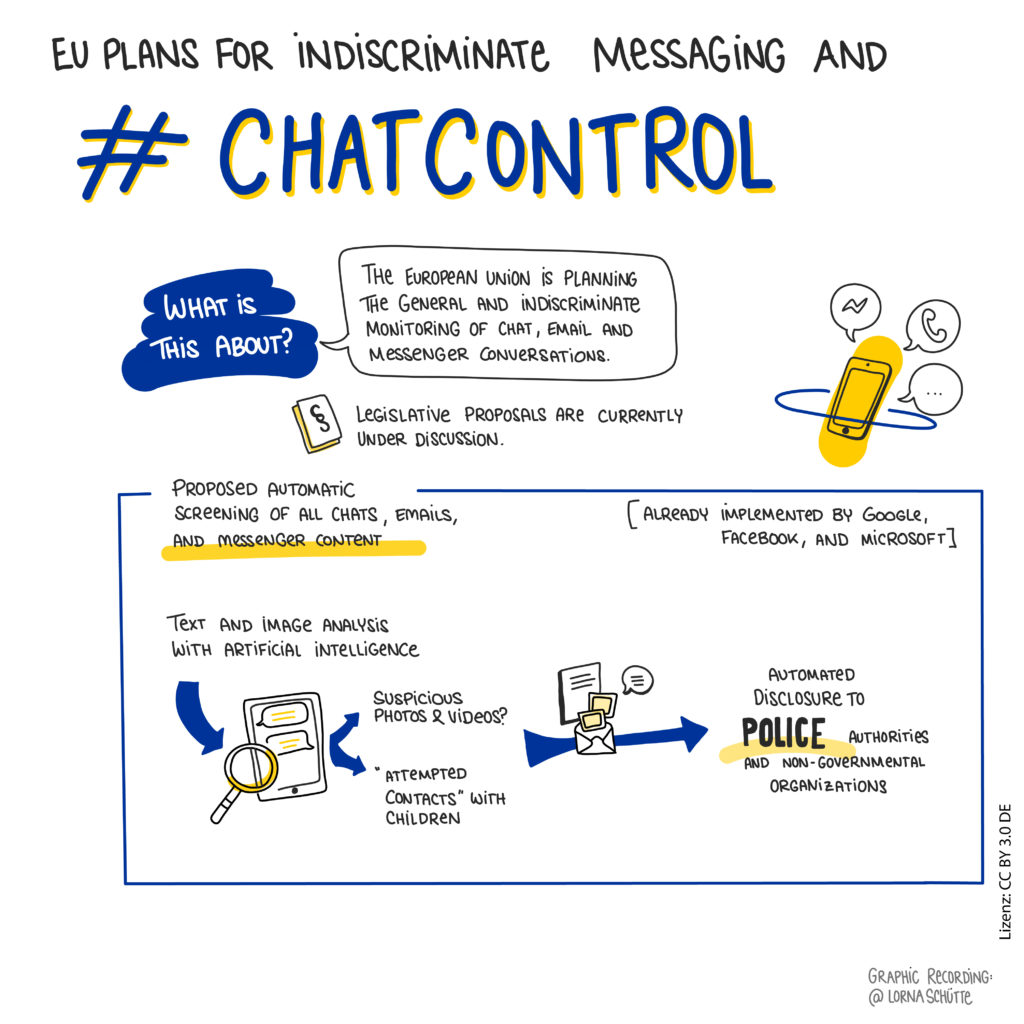

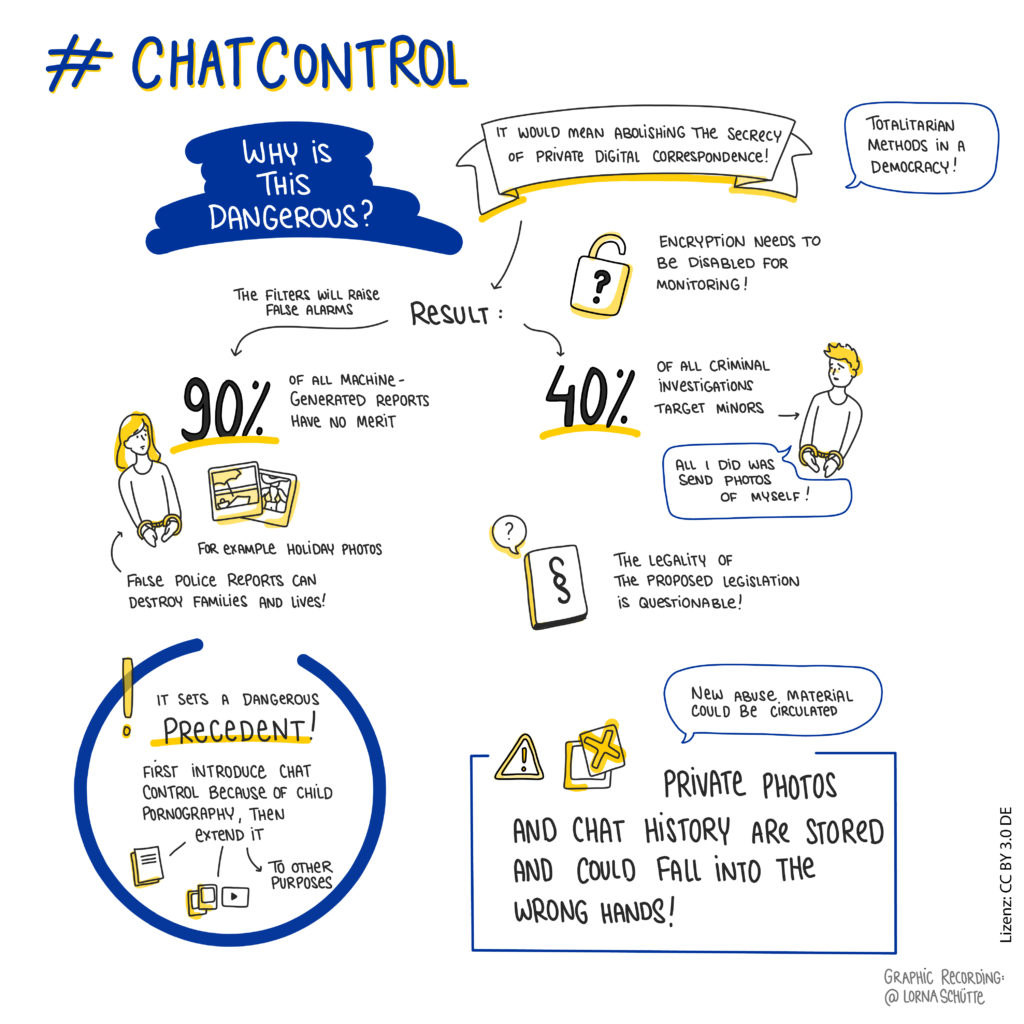

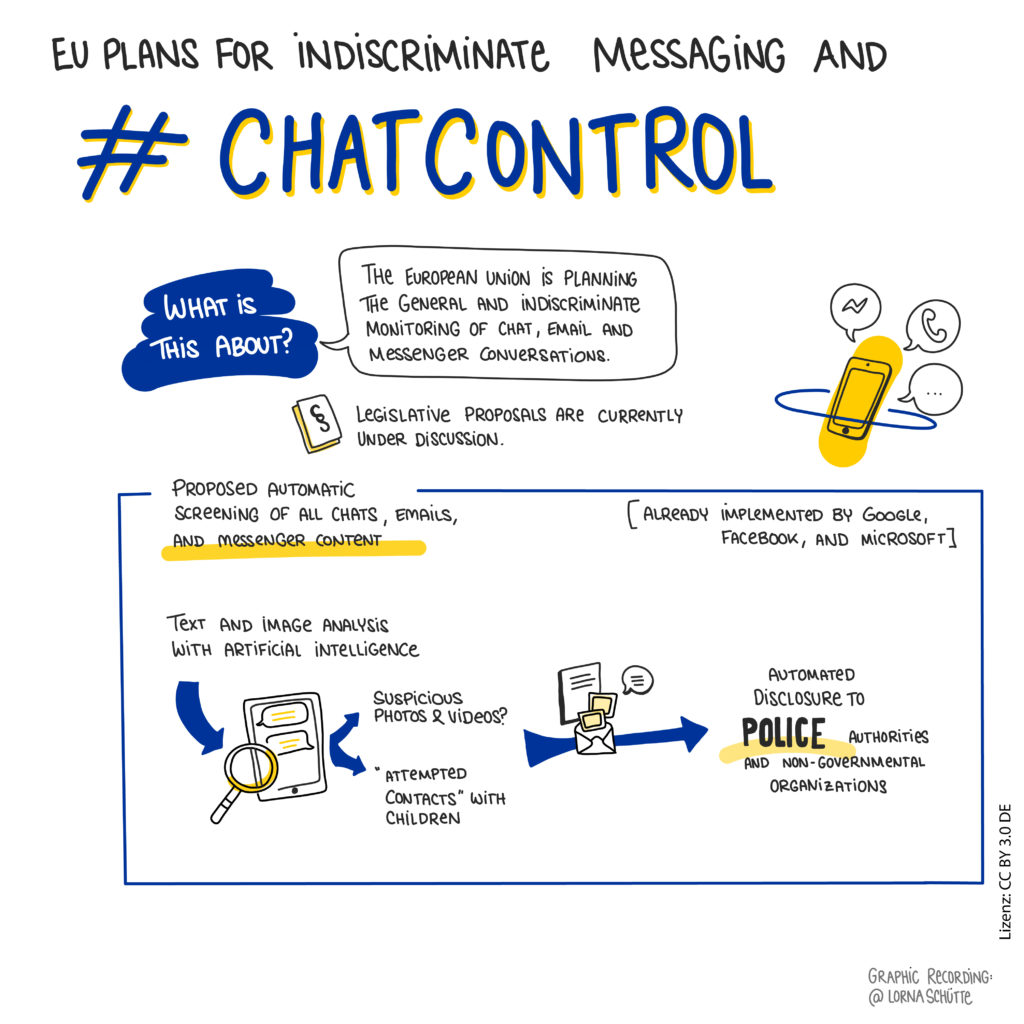

La Commissione europea propone di obbligare i fornitori a cercare automaticamente contenuti sospetti in tutte le chat private, i messaggi e le e-mail, in modo generale e indiscriminato. Lo scopo dichiarato: Perseguire il materiale di sfruttamento sessuale di minori (CSEM). Il risultato: sorveglianza di massa mediante sorveglianza in tempo reale completamente automatizzata di messaggistica e chat e fine della privacy della corrispondenza digitale.

Altri aspetti della proposta includono il blocco della rete inefficace, lo screening dell’archiviazione cloud personale comprese le foto private, la verifica obbligatoria dell’età con conseguente fine della comunicazione anonima, la censura dell’appstore e l’esclusione dei minori dal mondo digitale.

Controllo chat 2.0 su ogni Smartphone

L’11 maggio 2022 la Commissione europea ha presentato una proposta che renderebbe obbligatoria la ricerca del controllo della chat per tutti i provider di posta elettronica e di messaggistica e si applicherebbe anche ai servizi di comunicazione crittografati end-to-end finora sicuri. Prima della proposta, una consultazione pubblica aveva rivelato che la maggioranza degli intervistati, sia cittadini che parti interessate, si opponeva all’imposizione dell’obbligo di utilizzare il controllo della chat. Oltre l’80% degli intervistati si è opposto alla sua applicazione alle comunicazioni crittografate end-to-end.

Attualmente è in vigore un regolamento che consente ai fornitori di scansionare volontariamente le comunicazioni (il cosiddetto “Chat Control 1.0”). Finora solo alcuni servizi di comunicazione statunitensi non crittografati come GMail, Facebook/Instagram Messenger, Skype, Snapchat, e-mail iCloud e X-Box applicano volontariamente il controllo della chat (maggiori dettagli qui ). A seguito della proposta obbligatoria di Chat Control 2.0, la Commissione prevede un aumento di 3,5 volte dei rapporti di scansione (del 354% ).

La proposta di Chat Control 2.0

Questo è ciò che l’attuale proposta comporta in realtà:

Proposta di controllo della chat dell’UE

Sono previsti il controllo della chat, il blocco della rete, la verifica dell’età obbligatoria per messaggi e chat, la verifica dell’età per gli app store e l’esclusione dei minori dall’installazione di molte app

Tutti i servizi normalmente forniti dietro compenso (inclusi i servizi finanziati dalla pubblicità) rientrano nell’ambito, senza alcuna soglia in termini di dimensioni, numero di utenti, ecc.

Solo i servizi non commerciali che non sono finanziati dalla pubblicità, come molti software open source, sono esclusi

I servizi di comunicazione interessati includono telefonia, e-mail, messenger, chat (anche nell’ambito di giochi, su parti di giochi, su portali di incontri, ecc.), videoconferenza

Testi, immagini, video e discorsi (ad es. riunioni video, messaggi vocali, telefonate) dovrebbero essere scansionati

I servizi di messaggistica crittografati end-to-end non sono esclusi dall’ambito di applicazione

I fornitori di servizi di comunicazione crittografati end-to-end dovranno scansionare i messaggi su ogni smartphone (scansione lato client) e, in caso di hit, denunciare il messaggio alla polizia

I servizi di hosting interessati includono web hosting, social media, servizi di streaming video, file hosting e servizi cloud

Anche l’archiviazione personale che non viene condivisa, come iCloud di Apple, sarà soggetta al controllo della chat

I servizi che possono essere utilizzati per materiale illegale o per l’adescamento dei bambini sono obbligati a cercare il contenuto delle comunicazioni personali e dei dati memorizzati (controllo della chat) senza sospetto e indiscriminatamente

Poiché presumibilmente ogni servizio viene utilizzato anche per scopi illegali, tutti i servizi saranno obbligati a implementare il controllo della chat

L’autorità nel paese di stabilimento del fornitore è obbligata a ordinare l’implementazione del controllo della chat

Non c’è discrezionalità su quando e in che misura viene ordinato il controllo della chat

Il controllo della chat prevede la ricerca automatica di immagini e video CSEM noti, i messaggi/file sospetti verranno segnalati alla polizia

Secondo la Polizia Federale Svizzera,

l’80% delle denunce che ricevono (di solito basate sul metodo dell’hashing) sono penalmente irrilevanti.

Allo stesso modo in Irlanda solo

il 20% delle segnalazioni NCMEC ricevute nel 2020 è stato confermato come vero e proprio “materiale pedopornografico”.

Il controllo della chat prevede anche ricerche automatiche di immagini e video CSEM sconosciuti, i messaggi/file sospetti verranno segnalati alla polizia

La ricerca automatica di rappresentazioni di abusi sconosciuti è una procedura sperimentale che utilizza l’apprendimento automatico (“intelligenza artificiale”).

Gli algoritmi non sono accessibili al pubblico e alla comunità scientifica, né la bozza contiene alcun obbligo di divulgazione.

Il tasso di errore non è noto e non è limitato dal progetto di regolamento.

Presumibilmente, queste tecnologie si traducono in enormi quantità di falsi rapporti.

Il progetto di legge consente ai fornitori di trasmettere alla polizia i rapporti sui risultati automatizzati senza che gli esseri umani li controllino.

Il controllo della chat prevede ricerche automatiche per possibili adescamenti di bambini, i messaggi sospetti verranno segnalati alla polizia

La ricerca automatica della potenziale cura dei bambini è una procedura sperimentale che utilizza l’apprendimento automatico (“intelligenza artificiale”).

Gli algoritmi non sono disponibili al pubblico e alla comunità scientifica, né la bozza contiene un obbligo di divulgazione.

Il tasso di errore è sconosciuto e non è limitato dal progetto di regolamento, presumibilmente queste tecnologie provocano enormi quantità di segnalazioni false.

I servizi di comunicazione che possono essere utilizzati in modo improprio per la toelettatura dei bambini (quindi tutti) devono verificare l’età dei loro utenti

In pratica, la verifica dell’età implica l’identificazione completa dell’utente, il che significa che la comunicazione anonima via e-mail, messenger, ecc. sarà effettivamente vietata.

Gli informatori, i difensori dei diritti umani e i gruppi emarginati fanno affidamento sulla protezione dell’anonimato.

Gli app store devono verificare l’età dei propri utenti e impedire ai bambini/ragazzi di installare app che possono essere utilizzate in modo improprio a scopo di adescamento

Tutti i servizi di comunicazione come app di messaggistica, app di incontri o giochi possono essere utilizzati in modo improprio per la cura dei bambini (secondo i

sondaggi ) e verrebbero bloccati per l’uso da parte di bambini/ragazzi.

I fornitori di accesso a Internet possono essere obbligati a bloccare l’accesso a immagini e video vietati e non rimovibili ospitati al di fuori dell’UE mediante il blocco della rete (blocco degli URL)

Il blocco della rete è tecnicamente inefficace e facile da aggirare e comporta la costruzione di un’infrastruttura tecnica di censura

Analisi del progetto di relazione del relatore Javier Zarzalejos (PPE) (19 aprile 2023)

• Controllo chat: la ricerca indiscriminata obbligatoria di corrispondenza privata e dati di cittadini ignari è ancora in vigore. L’obbligo di “limitare l’ordine di rilevamento a una parte o componente identificabile di un servizio” come canali o gruppi specifici (AM 128) va a buon fine direzione ma non assicura che le ricerche siano mirate/limitate a persone specifiche presumibilmente collegate al CSEM, come richiesto per evitare l’annullamento dei provvedimenti di accertamento da parte della Corte di giustizia. I risultati del servizio di ricerca del Parlamento europeo non trovano ancora riscontro.

• Diversamente dalla Commissione, il relatore non vuole che gli utenti siano informati che la loro corrispondenza è stata (falsamente) segnalata (emendamento 138).

• “Rilevamento volontario”/Controllo chat : proposta di nuovo potere per i fornitori di ricercare corrispondenza privata e dati di cittadini ignari di propria iniziativa, anche laddove non siano soddisfatte le condizioni di un ordine di rilevamento (emendamento 99). Anche in questo caso non mirato/limitato a persone specifiche presumibilmente collegate al CSEM, come richiesto per evitare l’annullamento da parte della Corte di giustizia.

• Crittografia end-to-end : l’indebolimento della crittografia è escluso (AM 106), sebbene la formulazione non sia ancora sufficiente per escludere con certezza la scansione lato client obbligatoria (alcuni sostengono che la scansione lato client non interferirebbe con il processo di crittografia in quanto tale).

• Controllo dei metadati: proposta di un nuovo potere per la conservazione e l’analisi automatizzate dei metadati per modelli di comunicazione presumibilmente sospetti da parte dei fornitori (emendamento 106). Tale tecnologia è di nuovo closed-source e non valutata in modo indipendente, probabilmente inaffidabile con innumerevoli falsi positivi. La Commissione avverte che “i fornitori di servizi non considerano i metadati uno strumento efficace per rilevare il materiale pedopornografico” e “i metadati di solito non sono sufficienti per avviare

indagini” (p. 29). La maggior parte delle disposizioni proposte, ancora una volta, non garantisce che il trattamento sia mirato/limitato a persone specifiche presumibilmente collegate al CSEM, come richiesto dalla sentenza La Quadrature della Corte di giustizia (par. 172 pp.).

• Ordini di blocco dell’accesso/cancellazione dai motori di ricerca : il blocco dell’accesso inefficace al CSEM è ancora attivo. Proposta di un nuovo potere per rimuovere il CSEM dai motori di ricerca e dall'”intelligenza artificiale”. Entrambi sono inefficaci perché il materiale non viene cancellato alla fonte.

• Censura delle app per i bambini : è ancora in vigore l’obbligo per gli app store di impedire ai minori di installare app di comunicazione come Whatsapp, giochi o chat. La bozza di relazione propone di estendere questa censura delle app (AM 101 pp.).

• Divieto di comunicazioni anonime : l’obbligo sui servizi di comunicazione di verificare l’età degli utenti è ancora valido, con sistemi di verifica che escludono di fatto l’uso anonimo. Questa sarebbe la fine delle e-mail anonime o degli account di messaggistica di cui hanno bisogno gli informatori, gli attivisti politici ecc.

• Promettente: Proposta di istituire un Forum consultivo delle vittime (EM 273)

• Promettente: I servizi possono garantire un “elevato livello di privacy, sicurezza e protezione fin dalla progettazione e per impostazione predefinita ” (EM 79)

Altri video su Chatcontrol sono disponibili in questa playlist

I negoziati: la cronologia

2020: la Commissione europea propone una legislazione “temporanea” che consente il controllo della chat

La legislazione “provvisoria” proposta consente la ricerca di tutte le chat private, i messaggi e le e-mail per raffigurazioni illegali di minori e tentativi di avvio di contatti con minori. Ciò consente ai fornitori di Facebook Messenger, Gmail e altri di scansionare ogni messaggio alla ricerca di testo e immagini sospette. Ciò avviene in un processo completamente automatizzato, in parte utilizzando “intelligenza artificiale” soggetta a errori. Se un algoritmo considera un messaggio sospetto, il suo contenuto e i metadati vengono divulgati (di solito automaticamente e senza verifica umana) a un’organizzazione privata con sede negli Stati Uniti e da lì alle autorità di polizia nazionali di tutto il mondo. Gli utenti segnalati non vengono avvisati.

6 luglio 2021: il Parlamento europeo ha adottato la legislazione che consente il controllo della chat .

Il Parlamento europeo ha votato a favore della deroga ePrivacy, che consente il controllo volontario della chat per i provider di messaggistica e di posta elettronica. Di conseguenza, alcuni fornitori statunitensi di servizi come Gmail e Outlook.com stanno già eseguendo tali controlli automatici di messaggistica e chat.

9 maggio 2022: il membro del Parlamento europeo Patrick Breyer ha intentato una causa contro la società statunitense Meta.

Secondo la giurisprudenza della Corte di giustizia europea, l’analisi automatizzata permanente e completa delle comunicazioni private viola i diritti fondamentali ed è vietata (paragrafo 177). L’ex giudice della Corte di giustizia europea Prof. Dr. Ninon Colneric ha ampiamente analizzato i piani e conclude in una valutazione legale che i piani legislativi dell’UE sul controllo della chat non sono in linea con la giurisprudenza della Corte di giustizia europea e violano il diritti fondamentali di tutti i cittadini dell’UE al rispetto della vita privata, alla protezione dei dati e alla libertà di espressione. Su questa base è stata intentata la causa.

11 maggio 2022: la Commissione ha presentato una proposta per rendere obbligatorio il controllo della chat per i fornitori di servizi.

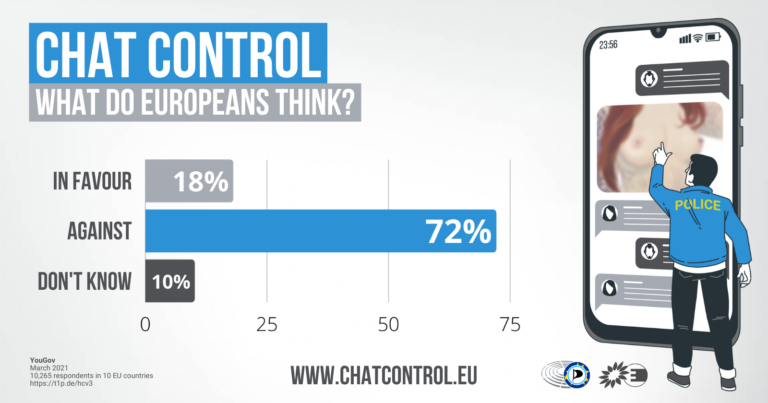

L’11 maggio 2022 la Commissione UE ha presentato una seconda proposta legislativa, in cui la Commissione UE obbliga tutti i fornitori di servizi di chat, messaggistica ed e-mail a implementare questa tecnologia di sorveglianza di massa in assenza di qualsiasi sospetto. Tuttavia, un sondaggio rappresentativo condotto nel marzo 2021 mostra chiaramente che la maggioranza degli europei si oppone all’uso del controllo della chat ( Risultati dettagliati del sondaggio qui) .

8 maggio, 22 giugno, 5 luglio, 25 luglio , 6 settembre, 22 settembre, 5 ottobre, 19 ottobre, 3 novembre, 24 novembre 2022:La proposta è stata discussa nell’ambito dei lavori del Council’s Law Enforcement Working Party

- 28 settembre:Workshop del Consiglio sulle tecnologie di rilevamento

- 10 ottobre:La proposta è stata presentata e discussa nella commissione LIBE del Parlamento europeottee ( registrazione video )

- 3 novembre 2022: riunione del Consiglio

- 24 novembre 2022: seminario del Consiglio sulla verifica dell’età e la crittografia

- 30 novembre 2022 : Primo incontro LIBE Shadows

- 14 dicembre 2022 : riunione ombra della commissione LIBE (audizioni)

- 10 gennaio 2023 : riunione ombra della commissione LIBE (audizioni)

- 19 e 20 gennaio 2023: riunione della polizia del gruppo di lavoro “Applicazione della legge” del Consiglio

- 24 gennaio 2023 : riunione ombra della commissione LIBE (audizioni)

- 7 febbraio 2023 : LIBE Shadows meeting (Tech Companies)

- 27 febbraio 2023 : LIBE Shadows meeting

- 7 marzo 2023 : incontro LIBE Shadows

- 16 marzo 2023 : gruppo di lavoro “Applicazione della legge” del Consiglio ( progetto di compromesso discusso )

- 21 marzo 2023 : incontro LIBE Shadows

- Fine marzo: presentazione della valutazione d’impatto sostitutiva

- 13 aprile 2023: dichiarazione del governo federale tedesco

- 13 aprile 2023: presentazione della valutazione d’impatto in LIBE

- 19 aprile 2023: il relatore della commissione LIBE presenta il progetto di relazione

- 26 aprile 2023: presentazione del progetto di relazione in LIBE

- 25 aprile 2023 : gruppo di lavoro “Applicazione della legge” del Consiglio ( progetto di compromesso discusso )

- 8-19 maggio 2023: Termine ultimo per la presentazione degli emendamenti

- 31 maggio 2023 : Incontro delle ombre

- 7 giugno 2023 : Incontro delle ombre

- 8 e 9 giugno 2023: il Consiglio “Giustizia e affari interni” adotta un orientamento generale parziale

- 28 giugno 2023 : Incontro delle ombre

- 5 luglio 2023 : Incontro delle ombre

- 12 luglio 2023 : Incontro delle ombre

- 19 luglio 2023 : Incontro delle ombre

- Settembre 2023: votazione in commissione LIBE

- Ottobre 2023: Votazione in Plenaria

- Dicembre 2023: accordo di trilogo

I negoziatori

Gli attori coinvolti nel Parlamento europeo:Relatoree relatori ombra

In che modo questo ti influenza?

Scansione del controllo della messaggistica e della chat:

- Tutte le tue conversazioni in chat e le e-mail verranno automaticamente ricercate per contenuti sospetti. Nulla rimane confidenziale o segreto. Non è richiesto un ordine del tribunale o un sospetto iniziale per la ricerca dei tuoi messaggi. Si verifica sempre e automaticamente.

- Se un algoritmo classifica il contenuto di un messaggio come sospetto, le tue foto private o intime potrebbero essere visualizzate da personale e appaltatori di società internazionali e autorità di polizia. Anche le tue foto private di nudo possono essere guardate da persone a te sconosciute, nelle cui mani le tue foto non sono al sicuro.

- I flirt e il sexting possono essere letti dal personale e dagli appaltatori di società internazionali e autorità di polizia, perché i filtri di riconoscimento del testo alla ricerca di “adescamento dei bambini” spesso contrassegnano erroneamente le chat intime.

- Puoi essere falsamente denunciato e indagato per presunta diffusione di materiale di sfruttamento sessuale di minori. È noto, ad esempio, che gli algoritmi di controllo della messaggistica e della chat contrassegnano foto di vacanze completamente legali di bambini su una spiaggia. Secondo le autorità di polizia federale svizzere, l’80% di tutte le denunce generate dalla macchina risultano prive di fondamento. Allo stesso modo in Irlanda solo il 20% delle segnalazioni NCMEC ricevute nel 2020 è stato confermato come vero e proprio “materiale pedopornografico”. Quasi il 40% di tutte le procedure di indagine penale avviate in Germania per “pornografia infantile” prendono di mira i minori.

- Nel tuo prossimo viaggio all’estero, puoi aspettarti grossi problemi. I rapporti generati dalla macchina sulle tue comunicazioni potrebbero essere stati trasmessi ad altri paesi, come gli Stati Uniti, dove non esiste la privacy dei dati, con risultati incalcolabili.

- I servizi di intelligence e gli hacker potrebbero essere in grado di spiare le tue chat ed e-mail private. La porta sarà aperta a chiunque disponga dei mezzi tecnici per leggere i tuoi messaggi se la crittografia sicura viene rimossa per poter filtrare i messaggi.

- Questo è solo l’inizio . Una volta stabilita la tecnologia per il controllo della messaggistica e della chat, diventa molto facile utilizzarli per altri scopi. E chi garantisce che queste macchine di incriminazione non verranno utilizzate in futuro sui nostri smartphone e laptop?

Verifica dell’età:

- Non è più possibile impostare e-mail anonime o account di messaggistica o chattare in modo anonimo senza dover presentare un documento d’identità o il proprio volto, rendendosi identificabili e rischiando fughe di dati. Ciò inibisce, ad esempio, le chat sensibili relative alla sessualità, le comunicazioni anonime dei media con fonti (ad es. informatori) e l’attività politica.

- Se hai meno di 18 anni, non potrai più installare le seguenti app dall’app store (motivo addotto: rischio di toelettatura): app di messaggistica come Whatsapp, Snapchat, Telegram o Twitter, app di social media come Instagram, TikTok o Facebook, giochi come FIFA, Minecraft, GTA, Call of Duty, Roblox, app di appuntamenti, app di videoconferenza come Zoom, Skype, FaceTime.

- Se non utilizzi un appstore, il rispetto dell’età minima del provider verrà comunque verificato e applicato. Se hai meno di 16 anni non puoi più utilizzare Whatsapp a causa dei requisiti di verifica dell’età proposti; lo stesso vale per le funzioni online del gioco FIFA 23. Se hai meno di 13 anni non potrai più utilizzare TikTok, Snapchat o Instagram.

Fare clic qui per ulteriori argomenti contro la messaggistica e il controllo della chat

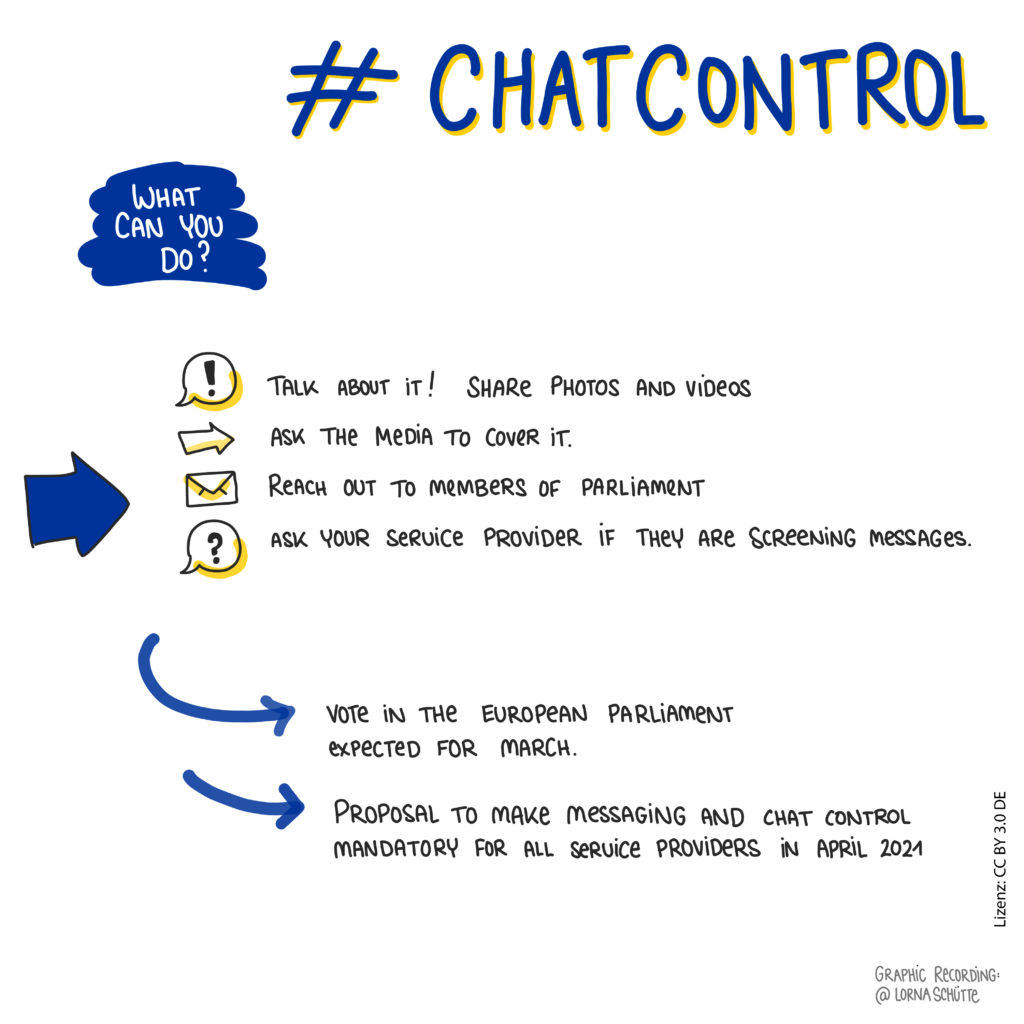

Cosa puoi fare

Teme che questa legge provochi un danno enorme ai diritti fondamentali ed è l’approccio sbagliato?

| Firma la petizione “ I bambini meritano un internet sicuro e protetto ” e condividila |

| Ciò che è importante ora è aumentare la pressione sui negoziatori: 1) Contatta il tuo governo che sta negoziando in Consiglio. Contatta la rappresentanza permanente del tuo governo o il tuo ministero dell’interno. 2) Entra in contatto con i tuoi Membri del Parlamento Europeo! I cosiddetti relatori ombra guidano i negoziati. Qui puoi trovare i recapiti: Javier Zarzalejos– relatore per il gruppo PPE Paul Tang – relatore ombra per il gruppo S&D Patrick Breyer – relatore ombra per il gruppo Verts/ALE Hilde Vautmans – relatore ombra per il gruppo Renew Annalisa Tardino – relatore ombra per il gruppo ID Vincenzo Sofo – relatore ombra per il gruppo ECR Cornelia Ernst – relatrice ombra per il gruppo di sinistra Esprimi gentilmente le tue preoccupazioni sul controllo della chat ( argomenti qui ). L’esperienza dimostra che le telefonate sono più efficaci delle e-mail o delle lettere. Il nome ufficiale della prevista legge obbligatoria sul controllo della chat è “Proposta di regolamento che stabilisce norme per prevenire e combattere gli abusi sessuali sui minori”. |

| Parlami di ciò! Informa gli altri sui pericoli del controllo della chat. Qui puoi trovare modelli di tweet, condividere foto e video . Naturalmente, puoi anche creare le tue immagini e i tuoi video. |

| Genera attenzione sui social media! Usa gli hashtag #chatcontrol e #secrecyofcorrespondence |

| Genera l’attenzione dei media! Finora pochissimi media hanno coperto i piani di controllo della messaggistica e della chat dell’UE. Mettiti in contatto con i giornali e chiedi loro di trattare l’argomento, online e offline. |

| Chiedi ai tuoi fornitori di servizi di posta elettronica, messaggistica e chat! Evita Gmail, Facebook Messenger, outlook.com e la funzione chat di X-Box, dove è già in atto un controllo indiscriminato della chat. Chiedi ai tuoi provider di posta elettronica, messaggistica e chat se in genere monitorano i messaggi privati alla ricerca di contenuti sospetti o se hanno intenzione di farlo. |

(fare clic destro sulle immagini e selezionare “Salva immagine con nome…”)

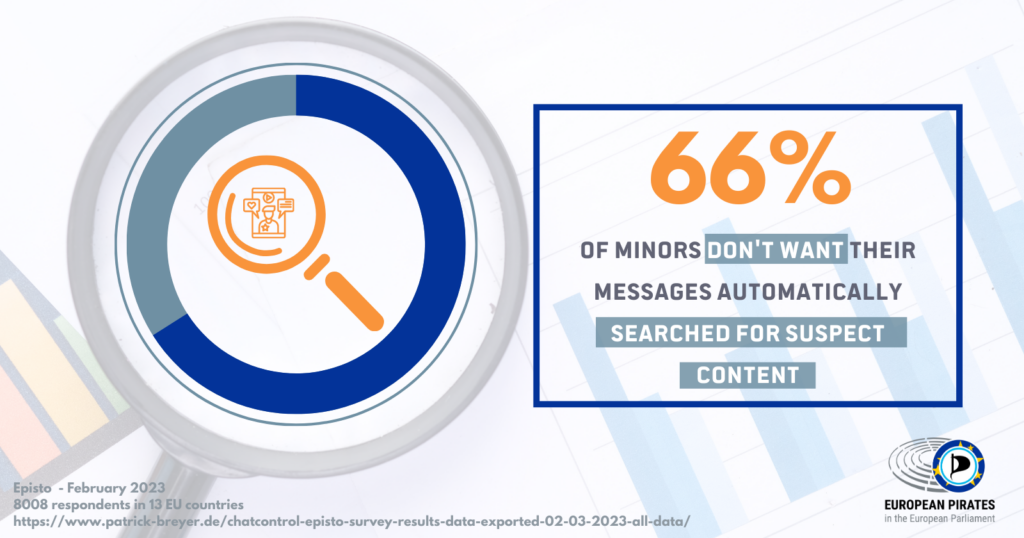

Risposte al Q2 del sondaggio tra i minori sul controllo della chat

Risposte al Q2 del sondaggio tra i minori sul controllo della chat Risposte alla Q6 del sondaggio tra i minori sul controllo della chat

Risposte alla Q6 del sondaggio tra i minori sul controllo della chat Risposte alla Q14 del sondaggio tra i minori sul controllo della chat

Risposte alla Q14 del sondaggio tra i minori sul controllo della chatUlteriori informazioni e argomenti

- Sfatare i miti

- Ulteriori informazioni e argomenti

- Alternative

- Pool di documenti

- Commento critico e ulteriori letture

Sfatare i miti

Quando nel maggio 2022 è stata presentata per la prima volta la bozza di legge sul controllo della chat, la Commissione Ue ha promosso il controverso piano con varie argomentazioni. Di seguito, varie affermazioni vengono messe in discussione e sfatate:

1. “Oggi su Internet circolano in maniera massiccia foto e video che ritraggono abusi sessuali su minori. Nel 2021, 29 milioni di casi sono stati segnalati al Centro nazionale statunitense per i bambini scomparsi e sfruttati.

Parlare esclusivamente di raffigurazioni di abusi sessuali su minori nel contesto del controllo della chat è fuorviante. A dire il vero, il materiale sullo sfruttamento sessuale di minori (CSEM) è spesso filmato di violenza sessuale contro minori (materiale di abuso sessuale di minori, CSAM). Tuttavia, sottolinea un gruppo di lavoro internazionale di istituzioni per la protezione dei minoritale materiale criminale include anche registrazioni di atti sessuali o di organi sessuali di minori in cui non viene usata violenza o non è coinvolta un’altra persona. Vengono menzionate anche registrazioni effettuate in situazioni quotidiane, come una foto di famiglia di una ragazza in bikini o nuda con gli stivali di sua madre. Sono coperte anche le registrazioni effettuate o condivise all’insaputa del minore. Punishable CSEM include anche fumetti, disegni, manga/anime e rappresentazioni generate al computer di minori immaginari. Infine, le raffigurazioni criminali includono anche registrazioni sessuali di minori realizzate da sé, ad esempio, per l’inoltro a partner della stessa età (“sexting”). Lo studio propone quindi il termine “raffigurazioni di sfruttamento sessuale” di minori come corretta descrizione. In questo contesto,

2. “Solo nel 2021, in tutto il mondo sono stati segnalati 85 milioni di immagini e video di abusi sessuali su minori”.

Circolano molte affermazioni fuorvianti su come quantificare l’entità delle immagini di sfruttamento sessuale di minori (CSEM). La cifra che la Commissione UE usa per difendere i suoi piani proviene dall’organizzazione non governativa statunitense NCMEC (National Center for Missing and Exploited Children) e include duplicati perché CSEM è condiviso più volte e spesso non cancellato. Escludendo i duplicati, rimangono 22 milioni di registrazioni uniche degli 85 milioni segnalati.

Il 75 percento di tutti i rapporti NCMEC del 2021 proveniva da Meta (FB, Instagram, Whatsapp). L’analisi interna di Facebook afferma che “oltre il 90 percento di [CSEM su Facebook nel 2020] era identico o visivamente simile ai contenuti precedentemente segnalati. E le copie di soli sei video erano responsabili di oltre la metà dei contenuti di sfruttamento dei minori”. Quindi i numeri tanto citati dell’NCMEC non descrivono realmente l’entità delle registrazioni online di violenza sessuale contro i bambini. Piuttosto, descrivono la frequenza con cui Facebook scopre copie di filmati di cui è già a conoscenza. Anche questo è rilevante.

Non tutte le registrazioni uniche segnalate all’NCMEC mostrano violenza contro i bambini. Gli 85 milioni di raffigurazioni segnalate da NCMEC includono anche il sexting consensuale, ad esempio. Il numero di raffigurazioni di abusi segnalate all’NCMEC nel 2021 è stato di 1,4 milioni.

Il 7% delle SAR globali di NCMEC va all’Unione Europea.

Inoltre, anche su Facebook, dove il controllo della chat è stato a lungo utilizzato volontariamente, i numeri per la diffusione di materiale offensivo continuano a salire. Il controllo della chat non è quindi una soluzione.

3. “Aumento del 64% delle segnalazioni di abusi sessuali confermati su minori nel 2021 rispetto all’anno precedente”.

Il fatto che gli algoritmi di controllo volontario della chat dei grandi fornitori statunitensi abbiano riportato più CSEM non indica come la quantità di CSEM si sia evoluta nel complesso. La stessa configurazione degli algoritmi ha un grande impatto sul numero di SAR. Inoltre, l’aumento dimostra che la circolazione del CSEM non può essere controllata attraverso il controllo della chat.

4. “L’Europa è l’hub globale per la maggior parte del materiale”.

Il 7% delle SAR NCMEC globali va all’Unione Europea. Per inciso, le forze dell’ordine europee come Europol e BKA consapevolmente non segnalano materiale abusivo ai servizi di stoccaggio per la rimozione, quindi la quantità di materiale immagazzinato qui non può diminuire.

5. “Un’indagine sostenuta da Europol basata su un rapporto di un fornitore di servizi online ha portato al salvataggio di 146 bambini in tutto il mondo, con oltre 100 sospetti identificati in tutta l’UE.”

La segnalazione è stata effettuata da un fornitore di servizi di archiviazione cloud, non da un fornitore di servizi di comunicazione. Per controllare l’archiviazione cloud, non è necessario imporre il monitoraggio delle comunicazioni di tutti. Se vuoi catturare gli autori di reati online relativi a materiale pedopornografico, dovresti utilizzare i cosiddetti honeypot e altri metodi che non richiedono il monitoraggio delle comunicazioni dell’intera popolazione.

6. “I mezzi esistenti per rilevare i contenuti pertinenti non saranno più disponibili quando l’attuale soluzione provvisoria scadrà”.

I fornitori di servizi di hosting (filehoster, cloud) e i fornitori di social media potranno continuare la scansione dopo la scadenza dell’esenzione ePrivacy. Per i fornitori di servizi di comunicazione, il regolamento di esenzione per la scansione volontaria della chat potrebbe essere esteso senza richiedere la scansione a tutti i fornitori.

7. metafore: il controllo della chat è “come un filtro antispam” / “come una calamita che cerca un ago in un pagliaio: la calamita non vede il fieno”. / “come un cane poliziotto che fiuta le lettere: non ha idea di cosa ci sia dentro.” Il contenuto della tua comunicazione non sarà visto da nessuno se non ci sono riscontri. “Il rilevamento a fini di sicurezza informatica è già in corso, come il rilevamento di collegamenti in WhatsApp” o filtri antispam.

I filtri antimalware e antispam non rivelano il contenuto delle comunicazioni private a terzi e non comportano la segnalazione di persone innocenti. Non comportano la rimozione o il blocco a lungo termine dei profili nei social media o nei servizi online.

8. “Per quanto riguarda il rilevamento di nuovo materiale offensivo in rete, il tasso di successo è ben oltre il 90 %. … Alcune tecnologie di rilevamento della toelettatura esistenti (come quelle di Microsoft) hanno un “tasso di precisione” dell’88%, prima della revisione umana.”

Con il numero ingestibile di messaggi, anche un piccolo tasso di errore si traduce in innumerevoli falsi positivi che possono superare di gran lunga il numero di messaggi corretti. Anche con un tasso di successo del 99%, ciò significherebbe che dei 100 miliardi di messaggi inviati quotidianamente solo tramite Whatsapp, 1 miliardo (ovvero 1.000.000.000) di falsi positivi dovrebbe essere verificato. E questo ogni giorno e solo su un’unica piattaforma. L ‘”onere della revisione umana” per le forze dell’ordine sarebbe immenso, mentre l’arretrato e il sovraccarico di risorse stanno già lavorando contro di loro.

Separatamente, una richiesta FOI dell’ex deputato europeo Felix Reda ha rivelato il fatto che queste affermazioni sull’accuratezza provengono dall’industria, da coloro che hanno un interesse acquisito in queste affermazioni perché vogliono venderti tecnologia di rilevamento (Thorn, Microsoft). Si rifiutano di sottoporre la loro tecnologia a test indipendenti e non dovremmo prendere per oro colato le loro affermazioni.

La sorveglianza di massa è l’approccio sbagliato per combattere la “pornografia infantile” e lo sfruttamento sessuale

- La scansione di messaggi privati e chat non contiene la diffusione di CSEM. Facebook, ad esempio, pratica da anni il controllo della chat e il numero di segnalazioni automatizzate è aumentato ogni anno, raggiungendo di recente i 22 milioni nel 2021.

- Il controllo obbligatorio della chat non rileverà gli autori che registrano e condividono materiale di sfruttamento sessuale di minori. Gli abusatori non condividono il loro materiale tramite e-mail commerciali, messenger o servizi di chat, ma si organizzano attraverso forum segreti autogestiti senza algoritmi di controllo. Inoltre, gli utenti in genere caricano immagini e video come archivi crittografati e condividono solo i collegamenti e le password. Gli algoritmi di controllo della chat non riconoscono archivi o collegamenti crittografati.

- L’approccio corretto consisterebbe nell’eliminare il file CSEM memorizzato dove è ospitato online. Tuttavia, Europol non segnala materiale CSEM noto.

- Il controllo della chat danneggia il perseguimento degli abusi sui minori inondando gli investigatori con milioni di segnalazioni automatizzate, la maggior parte delle quali penalmente irrilevanti.

Il controllo dei messaggi e della chat danneggia tutti

- Tutti i cittadini sono sospettati, senza motivo, di aver commesso un reato. I filtri di testo e foto monitorano tutti i messaggi, senza eccezioni. Nessun giudice è tenuto ad ordinare tale controllo – contrariamente al mondo analogico che garantisce la segretezza della corrispondenza e la riservatezza delle comunicazioni scritte. Secondo una sentenza della Corte di giustizia europea, l’analisi automatica permanente e generale delle comunicazioni private viola i diritti fondamentali (causa C-511/18, paragrafo 192). Ciononostante, l’UE intende ora adottare tale legislazione. Perché il tribunale lo annulli possono volerci anni. Pertanto, dobbiamo in primo luogo impedire l’adozione della legislazione.

- La riservatezza della corrispondenza elettronica privata viene sacrificata. Gli utenti di servizi di messaggistica, chat ed e-mail rischiano che i loro messaggi privati vengano letti e analizzati. Foto e contenuti di testo sensibili potrebbero essere inoltrati a entità sconosciute in tutto il mondo e cadere nelle mani sbagliate. Secondo quanto riferito, in passato il personale della NSA ha diffuso foto di nudi di cittadini di sesso femminile e maschile. È stato segnalato che un ingegnere di Google perseguita i minori.

- La messaggistica indiscriminata e il controllo della chat incriminano ingiustamente centinaia di utenti ogni giorno. Secondo la polizia federale svizzera, l’80% dei contenuti segnalati dalle macchine non è illegale, ad esempio le foto innocue delle vacanze che mostrano bambini nudi che giocano in spiaggia. Allo stesso modo in Irlanda solo il 20% delle segnalazioni NCMEC ricevute nel 2020 è stato confermato come vero e proprio “materiale pedopornografico”.

- La comunicazione crittografata in modo sicuro è a rischio. Fino ad ora, i messaggi crittografati non possono essere cercati dagli algoritmi. Per cambiare quella backdoor dovrebbe essere integrata nel software di messaggistica. Non appena ciò accade, questa falla nella sicurezza può essere sfruttata da chiunque disponga dei mezzi tecnici necessari, ad esempio dai servizi segreti stranieri e dai criminali. Le comunicazioni private, i segreti aziendali e le informazioni sensibili del governo verrebbero esposte. La crittografia sicura è necessaria per proteggere le minoranze, le persone LGBTQI, gli attivisti democratici, i giornalisti, ecc.

- La giustizia penale viene privatizzata. In futuro gli algoritmi di aziende come Facebook, Google e Microsoft decideranno quale utente è sospetto e quale no. La legislazione proposta non contiene requisiti di trasparenza per gli algoritmi utilizzati. In base allo stato di diritto, le indagini sui reati spettano a giudici indipendenti e funzionari pubblici sotto la supervisione del tribunale.

- Il controllo indiscriminato della messaggistica e della chat crea un precedente e apre le porte a tecnologie e legislazioni più invadenti . L’implementazione della tecnologia per il monitoraggio automatico di tutte le comunicazioni online è pericolosa: può essere facilmente utilizzata per altri scopi in futuro, ad esempio violazioni del copyright, abuso di droghe o “contenuti dannosi”. Negli stati autoritari tale tecnologia serve a identificare e arrestare oppositori del governo e attivisti democratici. Una volta che la tecnologia è stata implementata in modo completo, non si può tornare indietro.

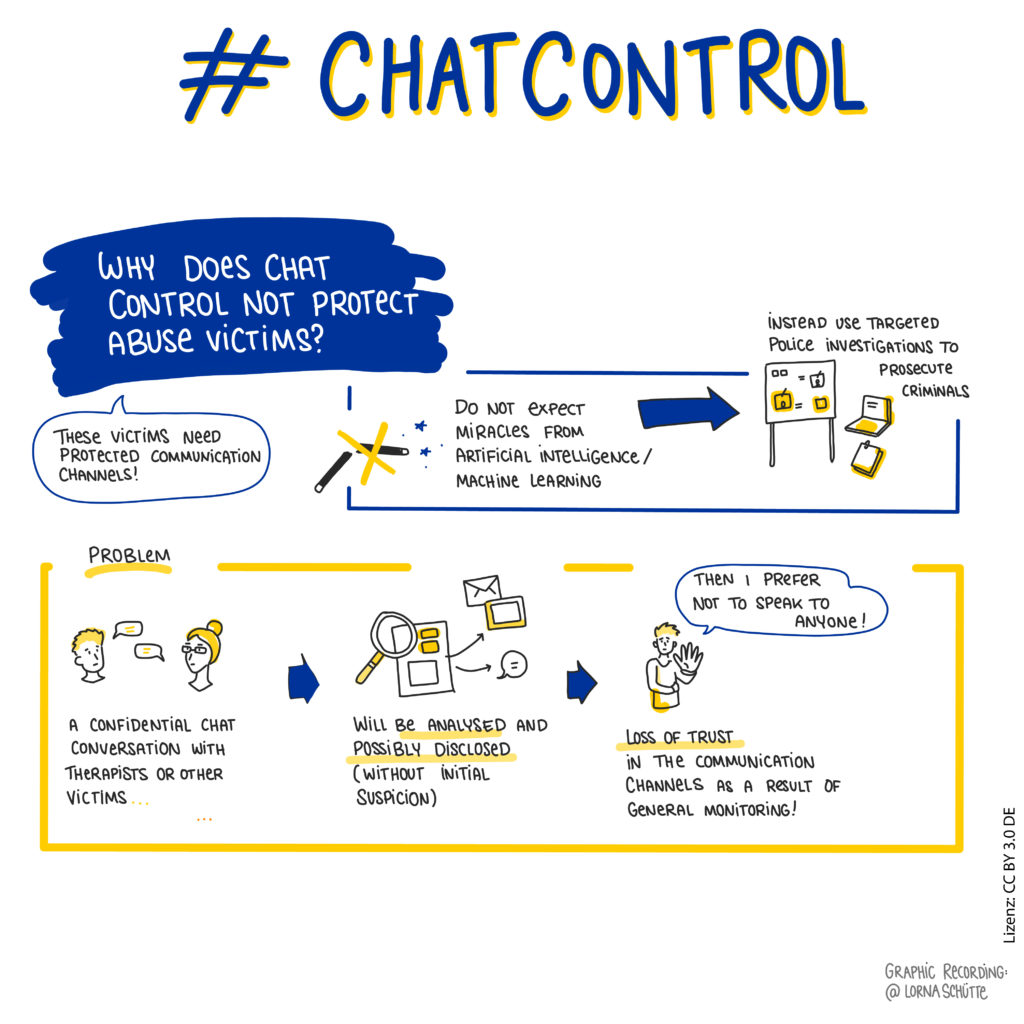

Il controllo della messaggistica e della chat danneggia i bambini e le vittime di abusi

I fautori affermano che la messaggistica indiscriminata e il controllo della chat facilitano il perseguimento dello sfruttamento sessuale dei minori. Tuttavia, questo argomento è controverso, anche tra le vittime di abusi sessuali su minori. Infatti la messaggistica e il controllo della chat possono ferire le vittime e le potenziali vittime di sfruttamento sessuale:

- Gli spazi sicuri vengono distrutti. Le vittime di violenza sessuale hanno particolarmente bisogno della capacità di comunicare in modo sicuro e confidenziale per cercare consulenza e sostegno, ad esempio per scambiarsi in sicurezza tra loro, con i loro terapisti o avvocati. L’introduzione del monitoraggio in tempo reale toglie loro queste stanze sicure. Ciò può scoraggiare le vittime dal cercare aiuto e sostegno.

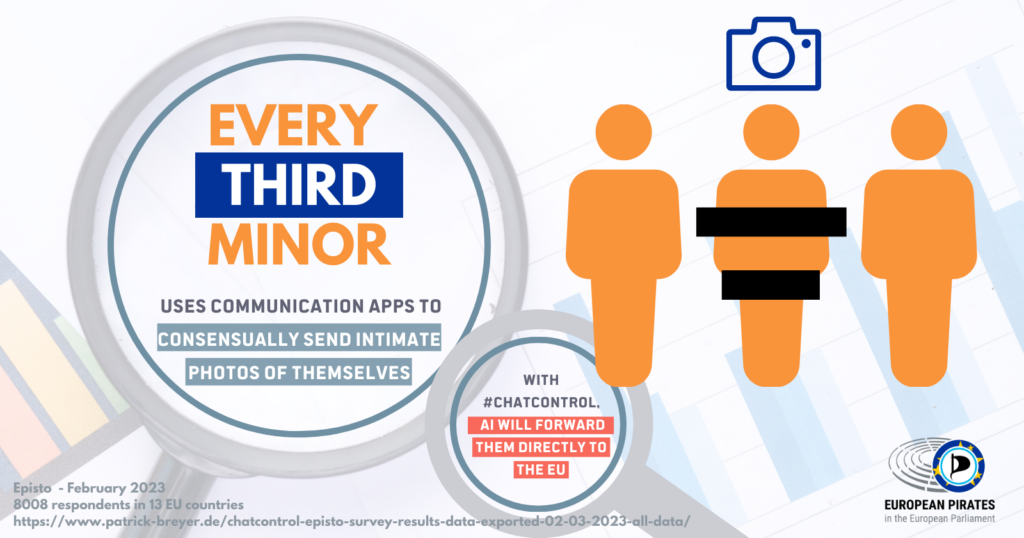

- Le foto di nudo di minori autoregistrate (sexting) finiscono nelle mani dei dipendenti dell’azienda e della polizia dove non appartengono e non sono al sicuro.

- I minori vengono criminalizzati. Soprattutto i giovani spesso condividono tra loro registrazioni intime (sexting). Con il controllo della messaggistica e della chat in atto, le loro foto e i loro video potrebbero finire nelle mani di investigatori criminali. Le statistiche tedesche sulla criminalità dimostrano che quasi il 40% di tutte le indagini per pornografia infantile prende di mira i minori.

- La messaggistica indiscriminata e il controllo della chat non limitano la circolazione di materiale illegale, ma in realtà rendono più difficile perseguire lo sfruttamento sessuale dei minori. Incoraggia i trasgressori a nascondersi e utilizzare server crittografati privati che possono essere impossibili da rilevare e intercettare. Anche sui canali aperti, la messaggistica indiscriminata e il controllo delle chat non contengono il volume di materiale circolato, come testimoniato dal numero sempre crescente di segnalazioni di macchine.

Alternative

Rafforzare la capacità delle forze dell’ordine

Attualmente, la capacità delle forze dell’ordine è così inadeguata che spesso occorrono mesi e anni per seguire le piste e analizzare i dati raccolti. Il materiale noto spesso non viene né analizzato né rimosso. I responsabili dell’abuso non condividono il loro materiale tramite Facebook o canali simili, ma sulla darknet. Per rintracciare autori e produttori, deve svolgersi un lavoro di polizia sotto copertura invece di sprecare le scarse capacità nel controllare rapporti di macchine spesso irrilevanti. È inoltre essenziale rafforzare le unità investigative responsabili in termini di personale, finanziamenti e risorse finanziarie, per garantire indagini a lungo termine, approfondite e sostenute. Devono essere sviluppati e rispettati standard/linee guida affidabili per la gestione da parte della polizia delle indagini sugli abusi sessuali.

Affrontare non solo i sintomi, ma la causa principale

Invece di tentativi tecnici inefficaci per contenere la diffusione del materiale di sfruttamento che è stato rilasciato, tutti gli sforzi devono concentrarsi in primo luogo sulla prevenzione di tali registrazioni. I concetti di prevenzione e formazione svolgono un ruolo chiave perché la stragrande maggioranza dei casi di abuso non viene mai nemmeno resa nota. Le organizzazioni di protezione delle vittime spesso soffrono di finanziamenti instabili.

Supporto rapido e facilmente disponibile per le (potenziali) vittime

- Meccanismi di segnalazione obbligatori presso i servizi online: al fine di ottenere un’efficace prevenzione degli abusi online e in particolare dell’adescamento, i servizi online dovrebbero essere tenuti a collocare in modo ben visibile le funzioni di segnalazione sulle piattaforme. Se il servizio è rivolto a e/o utilizzato da giovani o bambini, i fornitori dovrebbero anche essere tenuti a informarli sui rischi dell’adescamento online.

- Hotline e centri di consulenza: molte hotline nazionali che si occupano di casi di abusi segnalati sono alle prese con problemi finanziari. È essenziale garantire che vi sia una capacità sufficiente per dare seguito ai casi segnalati.

Migliorare l’alfabetizzazione mediatica

Insegnare l’alfabetizzazione digitale in tenera età è una parte essenziale della protezione per proteggere i bambini e i giovani online. I bambini stessi devono avere le conoscenze e gli strumenti per navigare in Internet in sicurezza. Devono essere informati che i pericoli si nascondono anche online e imparare a riconoscere e mettere in discussione i modelli di toelettatura. Ciò potrebbe essere ottenuto, ad esempio, attraverso programmi mirati nelle scuole e nei centri di formazione, in cui personale qualificato trasmette conoscenze e conduce discussioni. I bambini devono imparare a parlare, rispondere e denunciare gli abusi, anche se l’abuso proviene dalla loro sfera di fiducia (ad esempio, da persone a loro vicine o altre persone che conoscono e di cui si fidano), come spesso accade. Devono inoltre avere accesso a canali sicuri, accessibili e adeguati all’età per segnalare gli abusi senza timore.

Pool di documenti

- Osservatorio legislativo del PE (stato di avanzamento in continuo aggiornamento)

- Documenti del Consiglio (in continuo aggiornamento)

- Proposte di compromesso della presidenza: 12354/22 (15 settembre 2022), 13514/22 (12 ottobre 2022) e 14008/22 (26 ottobre 2022)

- Posizione comune del gruppo che la pensa allo stesso modo (LMG) degli Stati membri (27 aprile 2023)

- Parere Servizio giuridico del Consiglio (26 aprile 2023)

- Progetto di relazione del relatore (25 aprile 2023)

- Valutazione d’impatto complementare (aprile 2023)

- Verbale trapelato della riunione del gruppo di lavoro del Consiglio sull’applicazione della legge (LEWP) (16 marzo 2023)

- Sintesi della dichiarazione dell’Associazione per la protezione dell’infanzia (Der Kinderschutzbund Bundesverband eV) sull’audizione pubblica della commissione per gli affari digitali sul “controllo della chat” (1 marzo 2023)

- Sintesi della dichiarazione del Commissario federale per la protezione dei dati e la libertà di informazione sull’audizione pubblica della commissione per gli affari digitali del Bundestagon tedesco sul tema “Chat Control” (1 marzo 2023)

- Sintesi della dichiarazione Ufficio del pubblico ministero, centrale e punto di contatto per la criminalità informatica (ZAC) sull’audizione pubblica della commissione per gli affari digitali del Bundestag tedesco sul “controllo della chat” (1 marzo 2023)

- Presentazione dei risultati : valutazione d’impatto sostitutiva mirata sulla proposta della Commissione (25 gennaio 2023)

- Briefing dell’EPRS (dicembre 2022)

- Relazione sui progressi del Consiglio (24 novembre 2022)

- Parere legale del servizio di ricerca del Bundestag tedesco (7 ottobre 2022)

- Briefing per la commissaria Ylva Johansson per un incontro con un ministro francese (27 settembre 2022)

- Parere del Comitato economico e sociale europeo (13 settembre 2022)

- Consultazioni pubbliche della Commissione (chiuse il 12 settembre 2022), cfr. anche questa analisi delle risposte

- Parere congiunto EDPB-EDPS 4/2022 (28 luglio 2022)

- Verbale trapelato della riunione del gruppo di lavoro del Consiglio sull’applicazione della legge (LEWP) (20 luglio 2022)

- Progetto di regolamento relativo al controllo obbligatorio della chat e alla valutazione d’impatto (11 maggio 2022)

- Secondo parere del comitato per il controllo normativo (28 marzo 2022)

- Parere del comitato per il controllo normativo (15 febbraio 2022)

- Segnalazione 2021 sul controllo volontario della chat da parte di Meta , Twitter e Google

- Il parere trapelato della Commissione fa scattare campanelli d’allarme per la sorveglianza di massa delle comunicazioni private (23 marzo 2022)

- Risposta della Commissione in risposta a una lettera interpartitica contro il controllo obbligatorio della chat (9 marzo 2022)

- Regolamento sul controllo volontario della chat

- Parere legale del servizio di ricerca del Bundestag tedesco (4 agosto 2021)

- Risposte di Europol sulle statistiche riguardanti il perseguimento di materiale pedopornografico online (28 aprile 2021)

- Parere legale sulla compatibilità di Chatcontrol con la giurisprudenza della Corte di giustizia (marzo 2021)

- Valutazione d’impatto del Servizio Ricerca del Parlamento europeo (5 febbraio 2021)

- Risposte fornite dalla Commissione alle interrogazioni dei membri del Parlamento (27 ottobre 2020)

- Risposte fornite dalla Commissione alle interrogazioni dei membri del Parlamento (28 settembre 2020)

- Soluzioni tecniche per lo screening delle comunicazioni crittografate end-to-end (settembre 2020)

Commento critico e ulteriori letture

- Ufficio dell’Alto Commissariato per i Diritti Umani : “ Rapporto sul diritto alla privacy nell’era digitale ” (4 agosto 2022)

“I governi che cercano di limitare la crittografia spesso non sono riusciti a dimostrare che le restrizioni che avrebbero imposto sono necessarie per soddisfare un particolare interesse legittimo, data la disponibilità di vari altri strumenti e approcci che forniscono le informazioni necessarie per specifiche forze dell’ordine o altri scopi legittimi. Tali misure alternative includono una polizia tradizionale migliorata e dotata di risorse migliori, operazioni sotto copertura, analisi dei metadati e una cooperazione di polizia internazionale rafforzata”.

- Comitato delle Nazioni Unite sui diritti dell’infanzia , Commento generale n. 25 (2021) :

“Qualsiasi sorveglianza digitale dei minori, unitamente a qualsiasi trattamento automatizzato di dati personali associato, dovrebbe rispettare il diritto del minore alla privacy e non dovrebbe essere condotta di routine, indiscriminatamente o all’insaputa del minore…”

- Fondazione Prostasia: “ Come si è perso il materiale per la guerra contro gli abusi sui minori ” (19 agosto 2020)

- European Digital Rights (EDRi) : “ Sorvegliare i bambini li protegge davvero? Le nostre preoccupazioni sul regolamento provvisorio CSAM ” (24 settembre 2020)

- Organizzazioni della società civile : ” Lettera aperta: opinioni della società civile sulla difesa della privacy e sulla prevenzione di atti criminali ” (27 ottobre 2020)

“suggeriamo che la Commissione dia la priorità a questo lavoro non tecnico e alla rimozione più rapida dei siti Web offensivi rispetto al filtraggio lato client […]”

- Garante europeo della protezione dei dati : “ Parere sulla proposta di deroghe temporanee alla direttiva 2002/58/CE ai fini della lotta contro gli abusi sessuali sui minori online ” (10 novembre 2020)

“A causa dell’assenza di una valutazione d’impatto che accompagna la proposta, la Commissione deve ancora dimostrare che le misure previste dalla proposta sono strettamente necessarie, efficaci e proporzionate per raggiungere l’obiettivo prefissato.”

- Alexander Hanff (vittima di abusi sui minori e professionista della privacy): “ Perché non sostengo le misure invasive della privacy per affrontare gli abusi sui minori. ” (11 novembre 2020)

“Come sopravvissuto ad abusi, io (e milioni di altri sopravvissuti in tutto il mondo) facciamo affidamento su comunicazioni riservate sia per trovare supporto che per denunciare i crimini contro di noi – rimuovere i nostri diritti alla privacy e alla riservatezza significa sottoporci a ulteriori danni e, francamente, abbiamo sofferto abbastanza. […] non importa quali misure intraprendiamo per trovare gli autori di abusi, non importa quante libertà o diritti costituzionali distruggiamo per raggiungere quell’agenda – NON impedirà ai bambini di subire abusi, semplicemente spingerà il abusi ulteriormente clandestini, rendono sempre più difficile l’individuazione e alla fine portano ad abusi su più bambini come risultato finale.

- Vittima irlandese di abusi sessuali su minori (5 giugno 2022):

“Usare il velo della moralità e il pretesto di proteggere i più vulnerabili e amati nelle nostre società per introdurre questo potenziale mostro di iniziativa è spregevole”.

- Vittima tedesca di abusi sessuali su minori (25 maggio 2022):

“Soprattutto essendo vittima di abusi sessuali, per me è importante che sia possibile una comunicazione fidata, ad esempio nei gruppi di auto-aiuto e con i terapisti. Se la crittografia viene minata, ciò indebolisce anche le possibilità per le persone colpite da abusi sessuali di cercare aiuto”.

- Vittima francese di abusi sessuali su minori (23 maggio 2022):

“Essendo io stessa stata vittima di violenza sessuale da bambina, sono convinta che l’unico modo per andare avanti su questo tema sia attraverso l’educazione. La sorveglianza generalizzata delle comunicazioni non aiuterà i bambini a smettere di subire questa inaccettabile violenza”.

- AccessNow : “ Le preoccupazioni in materia di diritti fondamentali al centro delle nuove norme dell’UE sui contenuti online ” (19 novembre 2020)

“In pratica ciò significa che metterebbero le società private a capo di una questione che dovrebbero essere gestite dalle autorità pubbliche”

- Federazione federale degli avvocati (BRAK) (in tedesco): “ Stellungnahme zur Übergangsverordnung gegen Kindesmissbrauch im Internet ” (24 novembre 2020)

„la valutazione dei fatti relativi agli abusi sui minori fa parte dell’area di responsabilità della professione legale. Di conseguenza, la comunicazione scambiata tra avvocati e clienti conterrà spesso parole chiave pertinenti. […] Secondo le proposte della Commissione, c’è da temere che in tutte le suddette costellazioni ci sarà regolarmente una violazione della riservatezza a causa dell’inevitabile uso di termini pertinenti.

- Alexander Hanff (vittima di abusi sui minori e attivista per la privacy): ” Il Parlamento europeo sta per approvare una deroga che comporterà la sorveglianza totale di oltre 500 milioni di europei ” (4 dicembre 2020)

“Non avevo strumenti di comunicazione riservata quando sono stata stuprata; tutte le mie comunicazioni erano monitorate dai miei aggressori: non c’era niente che potessi fare, non c’era fiducia. […] Non posso fare a meno di chiedermi quanto sarebbe stata diversa la mia vita se avessi avuto accesso a queste moderne tecnologie. [Il previsto voto sulla e-Privacy Derogation] guiderà gli abusi nella clandestinità rendendoli molto più difficili da rilevare; impedirà ai gruppi di sostegno di essere in grado di aiutare le vittime di abusi – DISTRUGGERÀ VITE”.

- Garante tedesco per la protezione dei dati (in tedesco): „ BfDI kritisiert versäumte Umsetzung von EU Richtlinie “ (17 dicembre 2020)

“Un monitoraggio generale e non provocato dei canali di comunicazione digitale non è né proporzionato né necessario per rilevare gli abusi sui minori online. La lotta alla violenza sessuale sui minori deve essere affrontata con misure mirate e specifiche. Il lavoro investigativo è compito delle forze dell’ordine e non deve essere affidato a operatori privati di servizi di messaggistica”.

- European Digital Rights (EDRi): Intercettazione delle comunicazioni private dei bambini: quattro serie di problemi relativi ai diritti fondamentali per i bambini (e tutti gli altri) (10 febbraio 2021)

“Come con altri tipi di scansione dei contenuti (sia su piattaforme come YouTube che nelle comunicazioni private), scansionare tutto da tutti in ogni momento crea enormi rischi di portare alla sorveglianza di massa fallendo il test di necessità e proporzionalità. Inoltre, crea un pendio scivoloso in cui iniziamo a cercare casi meno dannosi (copyright) e poi passiamo a questioni più difficili (abusi sessuali su minori, terrorismo) e prima che ti rendi conto di cosa è successo, scansionare tutto tutto il tempo diventa la nuova normalità.

- Ordine degli avvocati tedesco (DAV): “La scansione indiscriminata delle comunicazioni è sproporzionata” (9 marzo 2021)

“La DAV è esplicitamente favorevole a combattere la preparazione e la commissione di abusi sessuali su minori e la loro diffusione via Internet attraverso misure efficaci a livello dell’UE. Tuttavia, il regolamento provvisorio proposto dalla Commissione consentirebbe violazioni palesemente sproporzionate dei diritti fondamentali degli utenti dei servizi di comunicazione basati su Internet. Inoltre, il regolamento provvisorio proposto non dispone di garanzie procedurali sufficienti per le persone interessate. Questo è il motivo per cui la proposta legislativa dovrebbe essere respinta nel suo insieme”.

- Lettera del presidente dell’Ordine degli avvocati tedesco (DAV) e del presidente dell’Ordine federale degli avvocati (BRAK) (in tedesco) (8 marzo 2021)

“Colpi positivi con successiva divulgazione ad agenzie governative e non governative sarebbero temuti non solo dagli imputati ma soprattutto dalle vittime di abusi sessuali su minori. In questo contesto, l’assoluta riservatezza della consulenza legale è indispensabile nell’interesse delle vittime, specialmente in queste questioni che sono spesso cariche di vergogna. In questi casi in particolare, il cliente deve mantenere la facoltà di decidere quali contenuti del mandato possono essere comunicati a chi. In caso contrario, c’è da temere che le vittime di abusi sessuali su minori non cercheranno consulenza legale”.

- Autonomia strategica in pericolo: le aziende tecnologiche europee avvertono di abbassare i livelli di protezione dei dati nell’UE (15 aprile 2021)

“Nel corso dell’iniziativa “Lotta agli abusi sessuali sui minori: rilevamento, rimozione e segnalazione di contenuti illegali”, l’Unione Europea prevede di abolire la privacy digitale della corrispondenza. Per rilevare automaticamente i contenuti illegali, in futuro tutti i messaggi di chat privati dovranno essere controllati. Questo dovrebbe valere anche per i contenuti che finora sono stati protetti con una forte crittografia end-to-end. Se questa iniziativa venisse attuata secondo il piano attuale danneggerebbe enormemente i nostri ideali europei ei fondamenti indiscutibili della nostra democrazia, vale a dire la libertà di espressione e la tutela della privacy […]. L’iniziativa danneggerebbe inoltre gravemente l’autonomia strategica dell’Europa e quindi le imprese con sede nell’UE.

- Articolo in ” Welt.de: Crime scanner su ogni smartphone – L’UE pianifica un grande attacco di sorveglianza “ (in tedesco) (4 novembre 2021)

Esperti della polizia e del mondo accademico sono piuttosto critici nei confronti del piano dell’UE: da un lato, temono molte false segnalazioni da parte degli scanner e, dall’altro, una funzione di alibi della legge. Daniel Kretzschmar, portavoce del Consiglio federale dell’Associazione degli investigatori criminali tedeschi, afferma che la lotta contro le rappresentazioni di abusi sui minori è “enormemente importante” per la sua associazione. Tuttavia, è scettico: persone insospettate potrebbero facilmente diventare il fulcro delle indagini. Allo stesso tempo, afferma, privatizzare queste iniziative investigative significa “rendere le forze dell’ordine dipendenti da queste società, che in realtà è un compito statale e sovrano. “

Anche Thomas-Gabriel Rüdiger, capo dell’Istituto di cybercriminologia presso l’Università di polizia di Brandeburgo, è piuttosto critico nei confronti del progetto UE. “Alla fine, probabilmente colpirà di nuovo principalmente i minori”, ha detto a WELT. Rüdiger fa riferimento ai dati della statistica criminale, secondo cui il 43 per cento dei reati registrati nell’area dei contenuti pedopornografici sarebbe riconducibile a bambini e adolescenti stessi. È il caso, ad esempio, del cosiddetto “sexting” e della “pornografia scolastica”, quando ragazzi di 13 e 14 anni si scambiano foto oscene.

I veri colpevoli, che vuoi davvero catturare, probabilmente preferirebbero non essere catturati. “Sono consapevoli di ciò che hanno fatto e utilizzano alternative. Presumibilmente, le chiavette USB e altri supporti dati verranno riutilizzati sempre di più”, continua Rüdiger.

- European Digital Rights (EDRi) : Controllo della chat: 10 principi per difendere i bambini nell’era digitale (9 febbraio 2022)

“Conformemente al diritto dell’UE in materia di diritti fondamentali, la sorveglianza o l’intercettazione di comunicazioni private o dei relativi metadati per individuare, indagare o perseguire il materiale pedopornografico online deve essere limitata a veri sospetti nei confronti dei quali sussistono ragionevoli sospetti, deve essere debitamente giustificata e specificamente giustificata e deve seguire le norme nazionali e dell’UE in materia di polizia, giusto processo, buona amministrazione, non discriminazione e tutela dei diritti fondamentali.

- Diritti digitali europei (EDRi) : il parere trapelato della Commissione fa scattare campanelli d’allarme per la sorveglianza di massa delle comunicazioni private (23 marzo 2022)

In vista della proposta ufficiale entro la fine dell’anno, esortiamo tutti i Commissari europei a ricordare le proprie responsabilità nei confronti dei diritti umani e a garantire che una proposta che minaccia l’essenza stessa del diritto alla privacy delle persone e la pietra angolare della società democratica, non viene proposto.

- Consiglio delle società informatiche professionali europee (CEPIS): l’Europa ha il diritto a comunicazioni sicure e a una crittografia efficace (marzo 2022)

“Secondo i nostri esperti, accademici e professionisti IT, tutti gli sforzi per intercettare e monitorare ampiamente le comunicazioni chat tramite la scansione del sito del cliente hanno un enorme impatto negativo sulla sicurezza IT di milioni di utenti Internet e aziende europee. Pertanto, il diritto europeo alla sicurezza delle comunicazioni e alla crittografia efficace per tutti deve diventare uno standard”.

LINK AL POST ORIGINALE

I commenti sono disabilitati, ma se vuoi segnalare un errore o aggiungere un contributo, puoi scriverci su Twitter o su Mastodon